| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | ||

| 6 | 7 | 8 | 9 | 10 | 11 | 12 |

| 13 | 14 | 15 | 16 | 17 | 18 | 19 |

| 20 | 21 | 22 | 23 | 24 | 25 | 26 |

| 27 | 28 | 29 | 30 |

Tags

- 슬라이딩윈도우

- Python3

- GenAI

- gcp

- 파이썬기초100제

- 리트코드

- 니트코드

- 투포인터

- LeetCode

- dfs

- sql코테

- two-pointer

- GenerativeAI

- 자연어처리

- 생성형AI

- stratascratch

- 파이썬

- 릿코드

- 구글퀵랩

- 코드업

- codeup

- nlp

- Blazor

- medium

- slidingwindow

- Python

- 파이썬알고리즘

- SQL

- Microsoft

- 알고리즘

Archives

- Today

- Total

Tech for good

[Google Cloud Skills Boost(Qwiklabs)] Introduction to Generative AI Learning Path - 2. Introduction to Large Language Models 본문

IT/Cloud

[Google Cloud Skills Boost(Qwiklabs)] Introduction to Generative AI Learning Path - 2. Introduction to Large Language Models

Diana Kang 2023. 8. 27. 16:18https://www.youtube.com/playlist?list=PLIivdWyY5sqIlLF9JHbyiqzZbib9pFt4x

Generative AI Learning Path

https://goo.gle/LearnGenAI

www.youtube.com

- Pre-trained: for general purpose with a large data set

- Fine-tuned: for specific aims with a much smaller data set

- Transformer model (e.g. PaLM)

- A transformer model consists of encoder and decoder.

- Encoder - encodes the input sequence and passes it to the decoder

- Decoder - decodes the representations for a relevant task

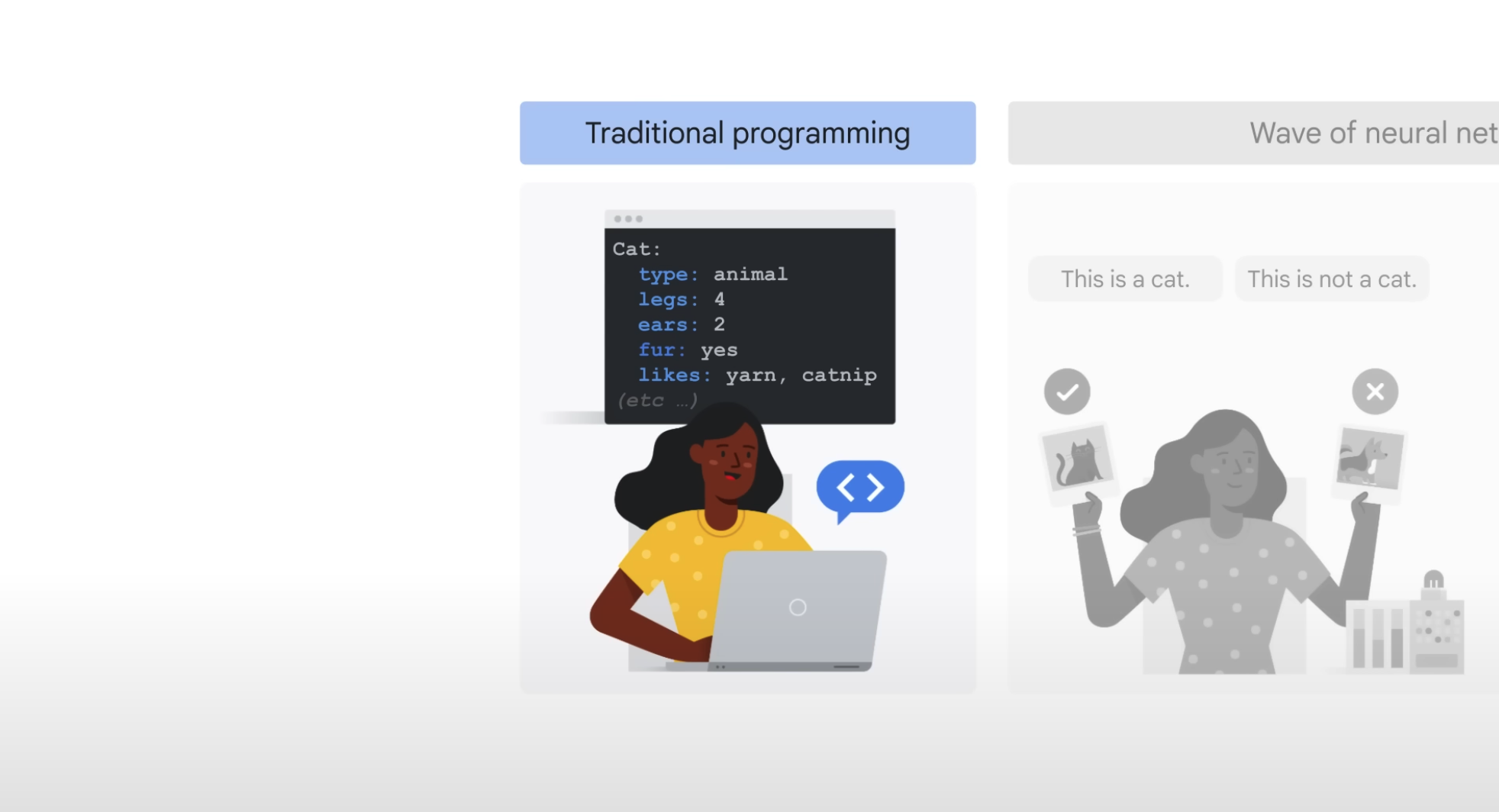

- Traditional programming -> 고양이를 구별하기 위해 규칙들을 하드코딩

- 신경망 기반 접근법 -> 고양이와 개 사진을 미리 주고, 예측하게 함.

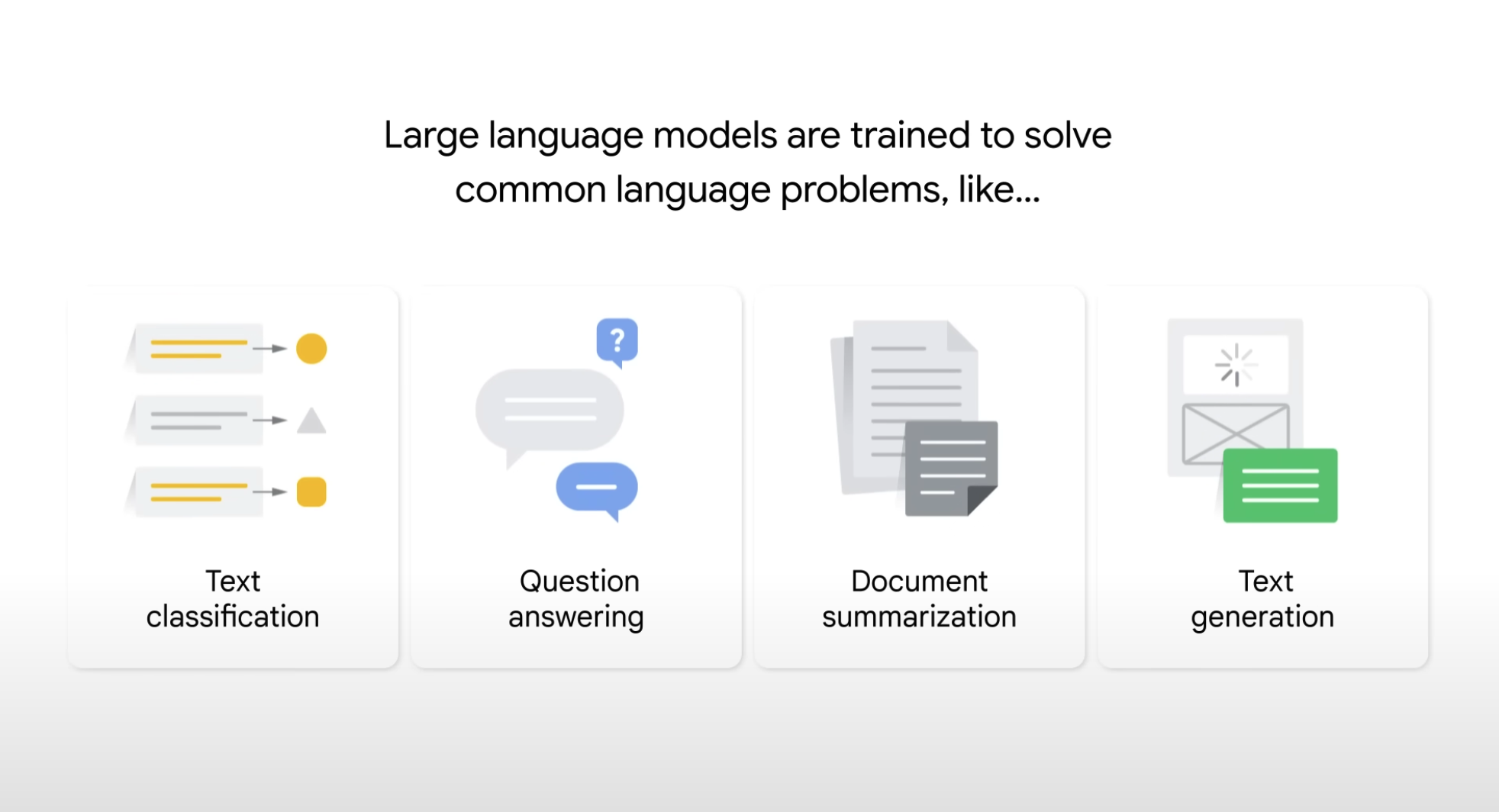

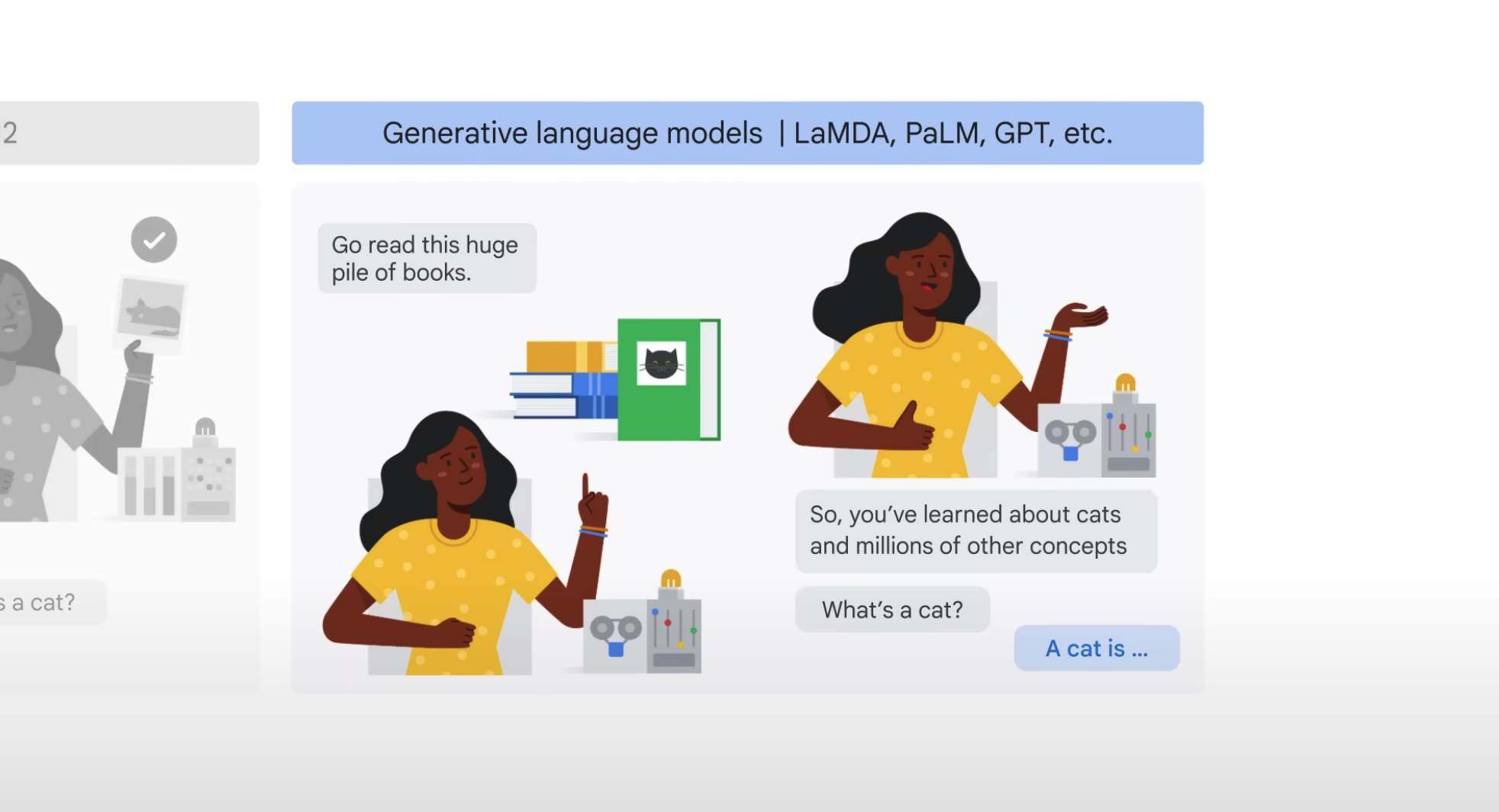

- 생성형 접근법 -> generate our own content (e.g. text, images, audio, video, etc..)

- 생성형 AI 모델들: ingest very large data from multiple sources across the Internet and build foundation language models